Kiến trúc Công nghệ Triển khai

Dual-Stack tại biên: Cảm biến ngoại vi + AI Models edge inference — Hybrid Cloud fallback

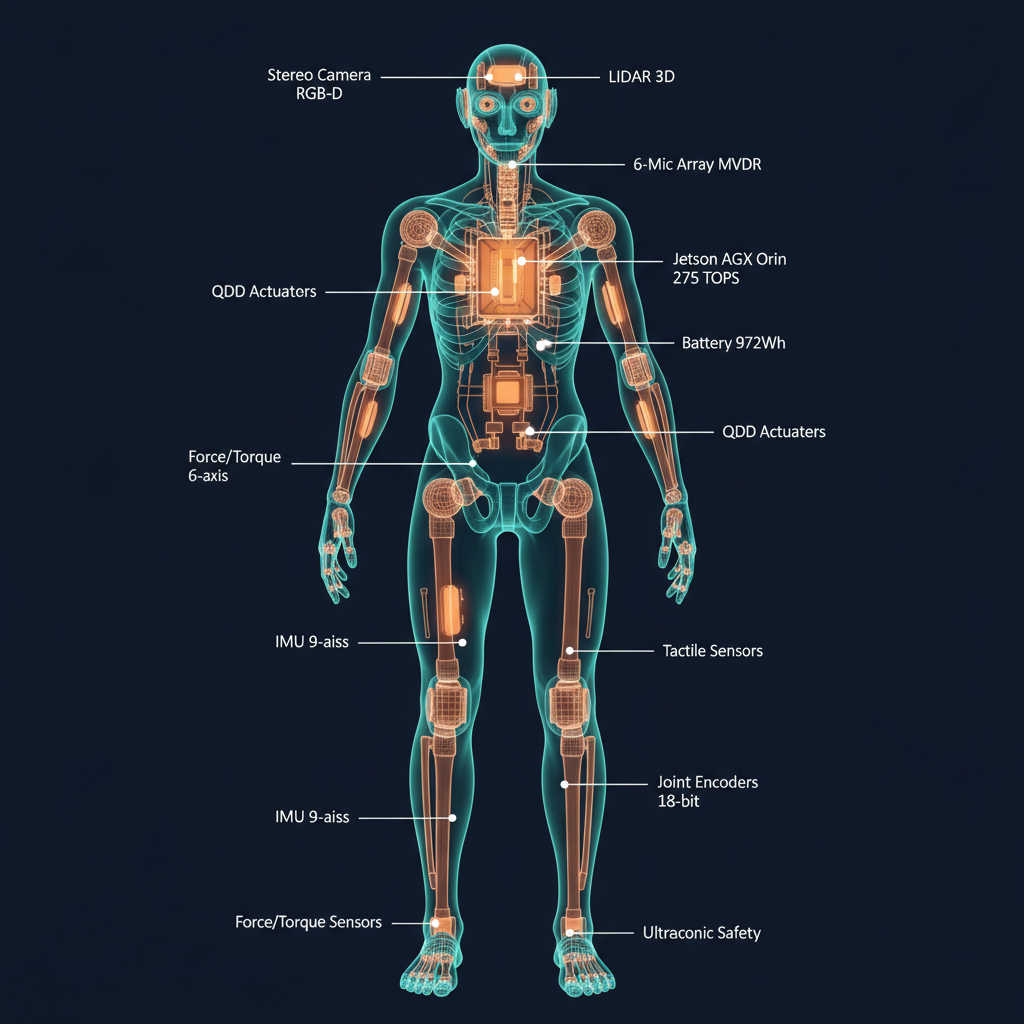

NHÓM 1 Cảm biến & Ngoại vi

POC 2025-26

Jetson AGX Orin

275 TOPS · 64GB

Scale 2027+

Jetson Thor

2,070 TFLOPS · 128GB

NHÓM 2 AI Models & Edge Inference

STT

PhoWhisper-medium (VinAI)

Edge

WER 3.65%

NLU

PhoBERT fine-tuned banking

Edge

<50ms

LLM

Qwen 2.5 7B INT4-AWQ

Edge

120 tok/s

LLM+

GPT-4o / Claude suy luận phức tạp

Cloud

500-2000ms

TTS

NVIDIA Riva / FPT.AI AceSound

Hybrid

100-400ms

CV

MediaPipe + YOLOv8 + ArcFace

Edge

<33ms

VLA

GR00T N1.6 Vision-Language-Action

Edge

120-200Hz

RAG

Pinecone/Qdrant ~5-10K chunks banking

Cloud

50-150ms

Hybrid Edge-Cloud: 80% xử lý tại biên (bảo mật + offline). Cloud fallback cho suy luận phức tạp. INT4-AWQ giảm 69% model size, chỉ mất 2-5% chất lượng.

Phase 1-2

API (GPT-4o) + Edge SLM

Phase 3-4

Custom Vietnamese Banking LLM

End-to-End Pipeline

Tổng: <1.5 giâyKhách hàng

→

Mic

20ms

→

STT

500ms

→

NLU

50ms

→

RAG

100ms

→

LLM

300ms

→

TTS

200ms

→

Robot

Edge

Cloud